[DMQA Open Seminar] Autoregressive Models in Vision (From Next-Token to Next-Scale Prediction)

Автор: 김성범[ 교수 / 산업경영공학부 ]

Загружено: 2025-10-11

Просмотров: 684

Описание:

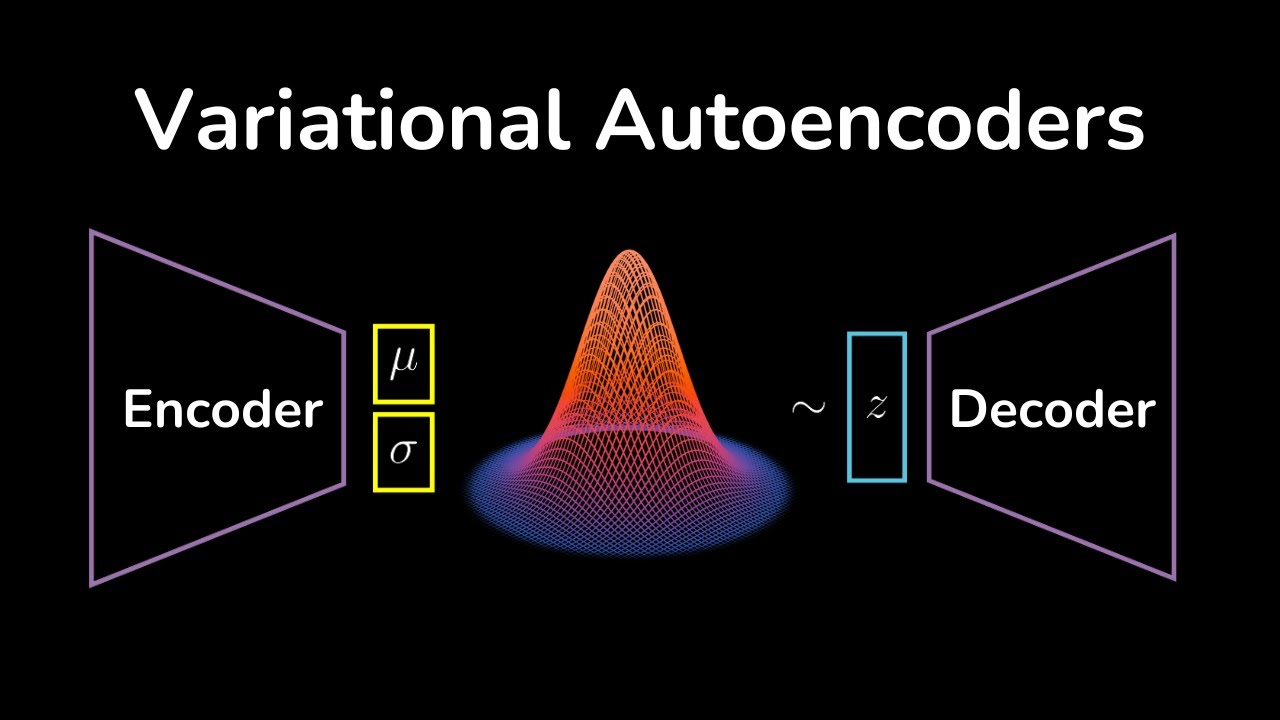

최근 LLM의 성공으로 인해 autoregressive 모델을 기반으로 한 이미지 생성 연구가 활발히 진행되고 있다. 기존에는 next-token prediction을 활용하는 방식이 주를 이루었으나, 최근에는 이를 대체하는 새로운 접근으로 next-scale prediction 기반의 모델링 방법이 제안되었다. 이 방법은 효율성을 확보하면서도 높은 생성 성능을 보여 많은 주목을받고 있다. 이번 세미나에서는 이러한 접근 방식을 대표하는 VAR(Visual Autoregressive Modeling) 논문을 살펴보고, 나아가 이 아이디어가 text-to-image generation으로 어떻게 확장될 수 있는지 살펴보고자 한다.

참고자료

[1] Xiong, J., Liu, G., Huang, L., Wu, C., Wu, T., Mu, Y., ... & Wong, N. (2024). Autoregressive models in vision: A survey. arXiv preprint arXiv:2411.05902.

[2] Tian, K., Jiang, Y., Yuan, Z., Peng, B., & Wang, L. (2024). Visual autoregressive modeling: Scalable image generation via next-scale prediction. Advances in neural information processing systems, 37, 84839-84865.

[3] Tang, H., Wu, Y., Yang, S., Xie, E., Chen, J., Chen, J., ... & Han, S. (2024). Hart: Efficient visual generation with hybrid autoregressive transformer. arXiv preprint arXiv:2410.10812.

[4] Han, J., Liu, J., Jiang, Y., Yan, B., Zhang, Y., Yuan, Z., ... & Liu, X. (2025). Infinity: Scaling bitwise autoregressive modeling for high-resolution image synthesis. In Proceedings of the Computer Vision and Pattern Recognition Conference (pp. 15733-15744).

Повторяем попытку...

![[DMQA Open Seminar] Autoregressive Models in Vision (From Next-Token to Next-Scale Prediction)](https://imager.clipsaver.ru/jbcEqF39mbo/max.jpg)

Доступные форматы для скачивания:

Скачать видео

-

Информация по загрузке:

![[Open DMQA Seminar] Multimodal Representation Alignment Using Disentangled Learning](https://imager.clipsaver.ru/G3szXvYD4SU/max.jpg)

![[Open DMQA Seminar] Test Time Prompt Tuning in Vision Language Models](https://imager.clipsaver.ru/8LxeghoUY9s/max.jpg)

![[Open DMQA Seminar] DINOv2, DINOv3: Self-supervised Vision Foundation Model](https://imager.clipsaver.ru/Nq95d7xhKAw/max.jpg)

![[DMQA Open Seminar] Weakly Supervised Semantic Segmentation](https://imager.clipsaver.ru/MwD7bcxl4mE/max.jpg)