EE. UU. declara la GUERRA a Anthropic: Lo que no quieren que sepas sobre Claude

Автор: Macoya Academy

Загружено: 2026-03-06

Просмотров: 22

Описание:

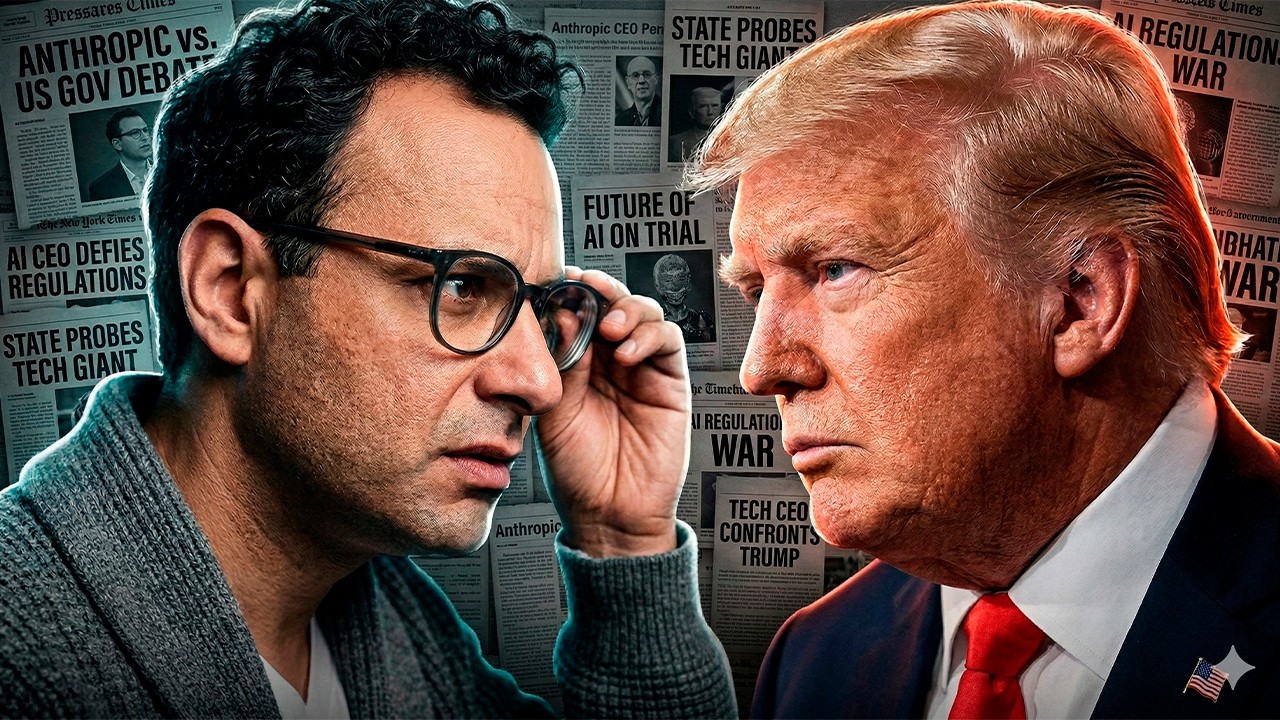

El día que la IA se enfrentó al Pentágono

El 27 de febrero de 2026, el panorama tecnológico cambió. No fue por el lanzamiento de un nuevo modelo, sino por una declaración de guerra burocrática. El Departamento de Defensa de los Estados Unidos (ahora llamado Departamento de Guerra) designó a Anthropic, una de las empresas de IA más valoradas del mundo, como un "riesgo para la cadena de suministro de la seguridad nacional".

Para entender por qué esto es un terremoto, piensa en Anthropic como el fabricante de un coche que se niega a instalar cámaras que envíen video directo a la policía. El gobierno no solo dejó de comprarles; ordenó a todas las agencias federales y contratistas militares que dejaran de usar su tecnología de inmediato.

Las dos líneas rojas de Anthropic

Dario Amodei, CEO de Anthropic, ha sido claro. Su empresa no nació para ser la más rápida, sino la más segura. Durante las negociaciones de un contrato de 200 millones de dólares, Anthropic puso condiciones inamovibles:

Vigilancia Masiva Doméstica: Se negaron a permitir que Claude fuera utilizado para analizar datos de ciudadanos estadounidenses a gran escala.

Armas Autónomas: Se negaron a que su IA tomara decisiones letales en el campo de batalla sin supervisión humana.

El gobierno, bajo la administración de Donald Trump y la dirección de Pete Hegseth, vio esto como un acto de "arrogancia" y "traición". Para ellos, si una tecnología es financiada o permitida en suelo americano, el Estado debe tener acceso "unrestricto" para cualquier uso legal.

¿Cómo te afecta esto a ti?

No se trata solo de política. Se trata de la arquitectura de la red en la que vives.

Tu Privacidad: Si el gobierno logra doblegar a empresas como Anthropic, el estándar de la industria pasará de "privacidad por diseño" a "acceso gubernamental por defecto".

El Efecto Dominó: Agencias como el Tesoro ya han cancelado contratos. Si trabajas para una empresa que hace negocios con el gobierno, es probable que ya tengas prohibido usar Claude para programar o analizar datos, afectando tu flujo de trabajo diario.

La Carrera de Armas Ética: OpenAI firmó un acuerdo con el Pentágono apenas horas después del colapso de Anthropic. Aunque OpenAI dice mantener principios éticos, la rapidez del acuerdo genera dudas. ¿Estamos creando una IA que obedece a la ética o una que obedece al poder?

El futuro: La batalla legal

Anthropic ha anunciado que llevará esto a los tribunales. Argumentan que la etiqueta de "riesgo de seguridad" es punitiva y carece de base legal, ya que históricamente se ha reservado para empresas enemigas como Huawei o Kaspersky. Este juicio será el momento "Roe vs. Wade" de la tecnología: ¿Quién es el dueño de la mente de una IA? ¿Su creador o el gobierno del país donde residen sus servidores?- Unete a Binance https://accounts.binance.com/es/regis... (Ayuda al canal como referido)

Whitelist Comunidad:

Повторяем попытку...

Доступные форматы для скачивания:

Скачать видео

-

Информация по загрузке: