Orthogonal Initialization in Neural Networks Explained with PyTorch | AI & Deep Learning Tutorial 🔥

Автор: MatrixMind

Загружено: 2025-08-15

Просмотров: 469

Описание:

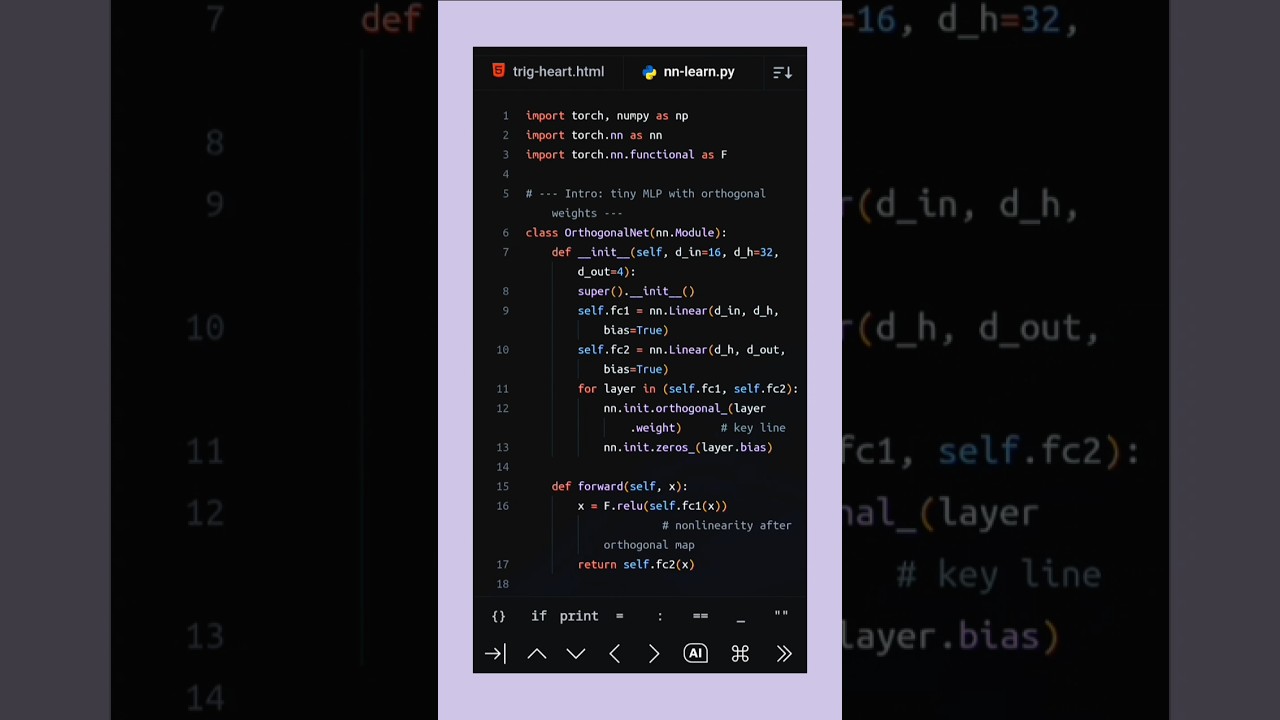

Boost your neural network performance with Orthogonal Initialization! 🚀 In this short and clear tutorial, we’ll explore how orthogonal matrices improve training stability, speed up convergence, and prevent vanishing or exploding gradients.

You’ll learn:

✅ What Orthogonal Initialization is in deep learning

✅ Why it’s important for efficient training

✅ How to implement it in PyTorch & NumPy

✅ Real benefits in AI model optimization

If you’re into AI, Machine Learning, Deep Learning, or PyTorch tips, this video is for you!

🔥 Don’t forget to Like, Subscribe, and hit the Bell icon for more AI tutorials.

📌 Code Notebook: https://aitoolskit.pro/notebook

#OrthogonalInitialization #PyTorchTutorial #DeepLearning #MachineLearning #NeuralNetworks #AIProgramming #PythonAI #AITools #DataScience #AIExplained #AIEngineering #GradientDescent #MLTips #AICode

Повторяем попытку...

Доступные форматы для скачивания:

Скачать видео

-

Информация по загрузке: