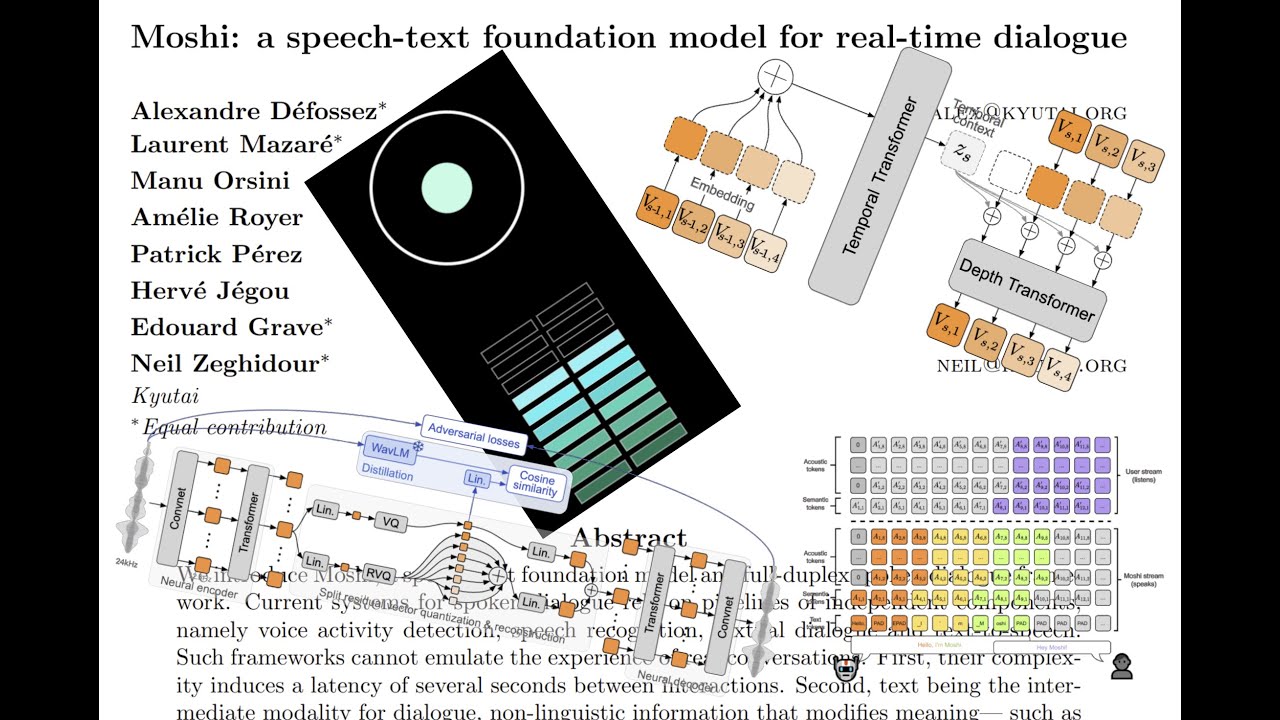

Moshi: a speech-text foundation model for real-time dialogue ( Paper Explained)

Автор: Julien Hauret

Загружено: 2024-10-30

Просмотров: 1427

Описание:

Review of: https://arxiv.org/abs/2410.00037

Abstract:

We introduce Moshi, a speech-text foundation model and full-duplex spoken dialogue framework. Current systems for spoken dialogue rely on pipelines of independent components, namely voice activity detection, speech recognition, textual dialogue and text-to-speech. Such frameworks cannot emulate the experience of real conversations. First, their complexity induces a latency of several seconds between interactions. Second, text being the intermediate modality for dialogue, non-linguistic information that modifies meaning -- such as emotion or non-speech sounds -- is lost in the interaction. Finally, they rely on a segmentation into speaker turns, which does not take into account overlapping speech, interruptions and interjections. Moshi solves these independent issues altogether by casting spoken dialogue as speech-to-speech generation. Starting from a text language model backbone, Moshi generates speech as tokens from the residual quantizer of a neural audio codec, while modeling separately its own speech and that of the user into parallel streams. This allows for the removal of explicit speaker turns, and the modeling of arbitrary conversational dynamics. We moreover extend the hierarchical semantic-to-acoustic token generation of previous work to first predict time-aligned text tokens as a prefix to audio tokens. Not only this "Inner Monologue" method significantly improves the linguistic quality of generated speech, but we also illustrate how it can provide streaming speech recognition and text-to-speech. Our resulting model is the first real-time full-duplex spoken large language model, with a theoretical latency of 160ms, 200ms in practice, and is available at this URL https://github.com/kyutai-labs/moshi

Authors:

Alexandre Défossez, Laurent Mazaré, Manu Orsini, Amélie Royer, Patrick Pérez, Hervé Jégou, Edouard Grave, Neil Zeghidour

Chapters:

0:00 Introduction

2:38 Mimi, neural audio codec

14:54 Helium, 7B text LLM

20:05 RQ-Transformer, Temporal and Depth transformer

28:45 Inner Monologue setup

33:58 Conclusion

35:35 Live demo in local

Повторяем попытку...

Доступные форматы для скачивания:

Скачать видео

-

Информация по загрузке: