Como a GPU multiplica matrizes? (spoiler: não é tão simples)

Автор: Waine - Dev do Desempenho

Загружено: 2024-05-06

Просмотров: 11827

Описание:

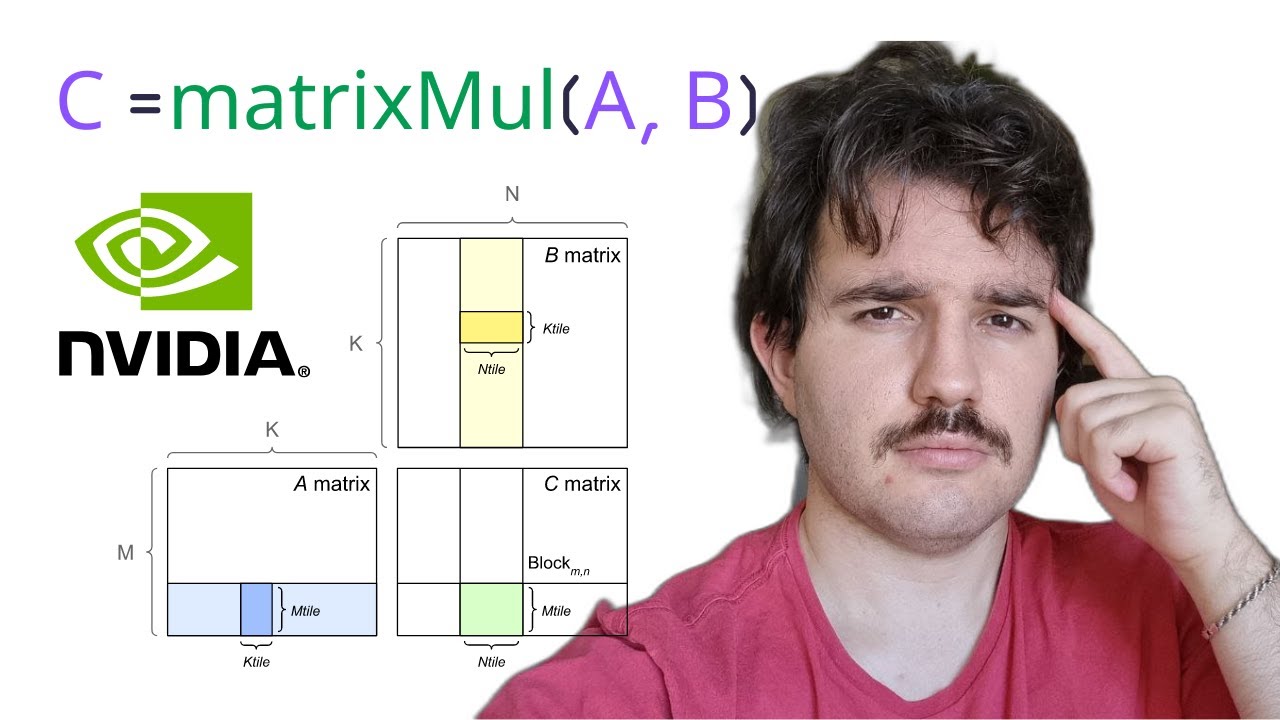

Ouvimos falar por todo lado que a GPU é ótima em multiplicações de matrizes. Mas como exatamente ela faz essa multiplicação? Como é o código? Qual algoritmo ela usa? Será que é só multiplicar linha e coluna ou tem mais coisa?

Aqui quero explicar linha por linha como a GPU faz essa operação, suas otimizações e os conceitos envolvidos nisso. Mesmo sendo um algoritmo e código relativamente simples, para entendê-lo é necessário ter vários conceitos já estabelecidos.

E esse é só o começo pra quem quer começar a programar em GPU, a partir daqui os algoritmos só ficam mais difíceis e complexos, mas com uma base de conhecimento forte, é possível aprender todos esses algoritmos e entender as "mágicas" que a GPU faz.

00:36 Multiplicação de matriz

01:34 Código simples em GPU

03:30 Dividir pra conquistar

05:23 Código

18:05 Conclusões

20:53 Comentários e sugestões

LINKS

Artigo sobre multiplicação de matriz: https://www.cise.ufl.edu/~sahni/paper...

Ilustração do algoritmo: https://docscontent.nvidia.com/dita/0...

CUDA Samples: https://github.com/NVIDIA/cuda-samples

Código do vídeo: https://github.com/NVIDIA/cuda-sample...

REDES

Site: https://www.wainejr.com/

Instagram: / waine_jr

GitHub: https://github.com/wainejr/

TikTok: / waine_jr

#GPU #CUDA #NVidia #C++ #C #Desempenho #Paralelismo #concorrência #OpenCL #Matrizes

Повторяем попытку...

Доступные форматы для скачивания:

Скачать видео

-

Информация по загрузке: