Прототипы с дифференциальной приватностью для несбалансированного трансферного обучения

Автор: Google TechTalks

Загружено: 2026-01-26

Просмотров: 90

Описание:

Доклад на Google TechTalk, 28.08.2024, представленный Дариушем Вахдани.

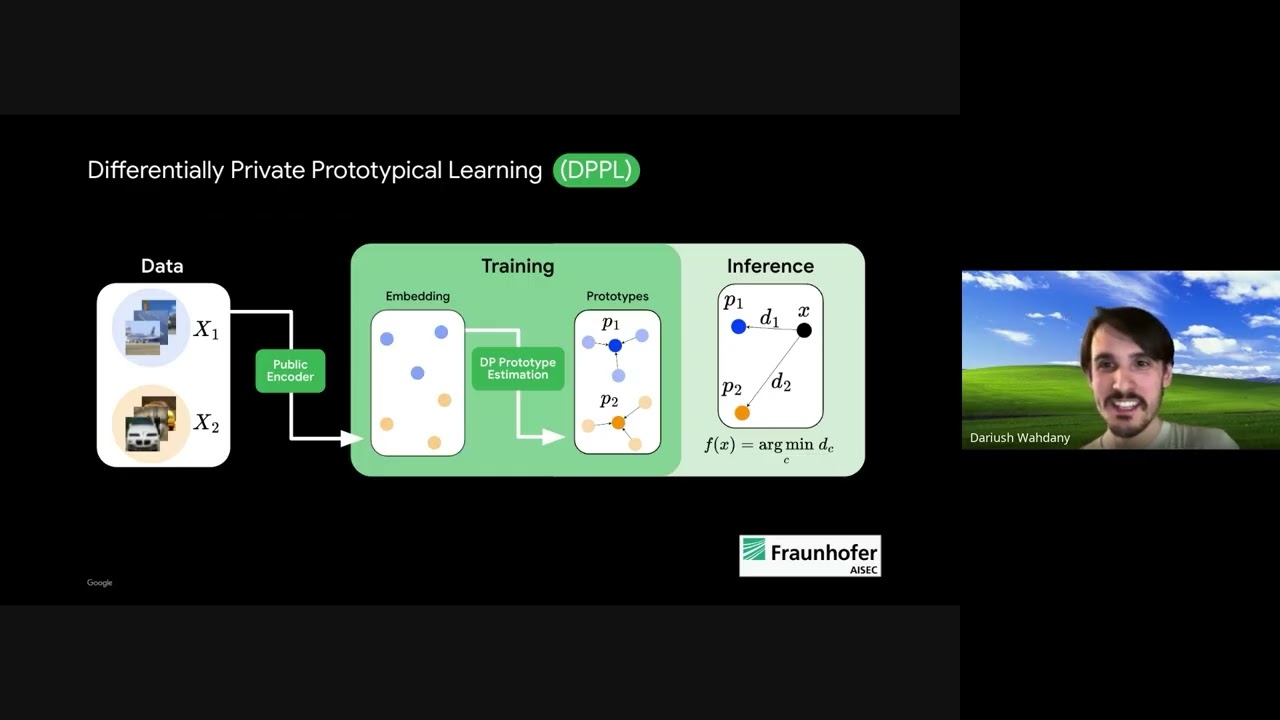

Семинар по конфиденциальности в машинном обучении. АННОТАЦИЯ: Было показано, что модели машинного обучения (МО) допускают утечку конфиденциальной информации из своих обучающих наборов данных. Дифференцированная конфиденциальность (ДП), обычно реализуемая с помощью алгоритма стохастического градиентного спуска с дифференциальной конфиденциальностью (ДП-СГС), стала стандартным решением для ограничения утечки информации из моделей. Несмотря на недавние улучшения, подходы к обучению с использованием ДП-СГС для обеспечения конфиденциальности по-прежнему обычно испытывают трудности в условиях высокой конфиденциальности ($\varepsilon\leq 1$) и малого объема данных, а также когда обучающие наборы данных с конфиденциальной информацией несбалансированы. Для преодоления этих ограничений мы предлагаем обучение прототипов с дифференциальной конфиденциальностью (ДПФ) в качестве новой парадигмы для трансферного обучения с обеспечением конфиденциальности. ДПФ использует общедоступные предварительно обученные кодировщики для извлечения признаков из конфиденциальных данных и генерирует прототипы ДП, которые представляют каждый конфиденциальный класс в пространстве вложений и могут быть публично выпущены для вывода. Поскольку наши прототипы DP можно получить всего из нескольких частных обучающих данных и без итеративного добавления шума, они обеспечивают высокую полезность прогнозов и надежные гарантии конфиденциальности даже в рамках концепции чистого DP. Мы также показываем, что компромисс между конфиденциальностью и полезностью может быть дополнительно улучшен при использовании общедоступных данных, выходящих за рамки предварительного обучения кодировщика: в частности, мы можем конфиденциально выбирать наши прототипы DP из общедоступных точек данных, используемых для обучения кодировщика. Наша экспериментальная оценка с четырьмя современными кодировщиками, четырьмя наборами данных для обработки изображений и в различных режимах данных и несбалансированности демонстрирует высокую производительность DPPL при надежных гарантиях конфиденциальности в сложных условиях обучения с использованием частных данных.

Повторяем попытку...

Доступные форматы для скачивания:

Скачать видео

-

Информация по загрузке: