Оптимизация вывода (технический обзор в блоге NVIDIA)

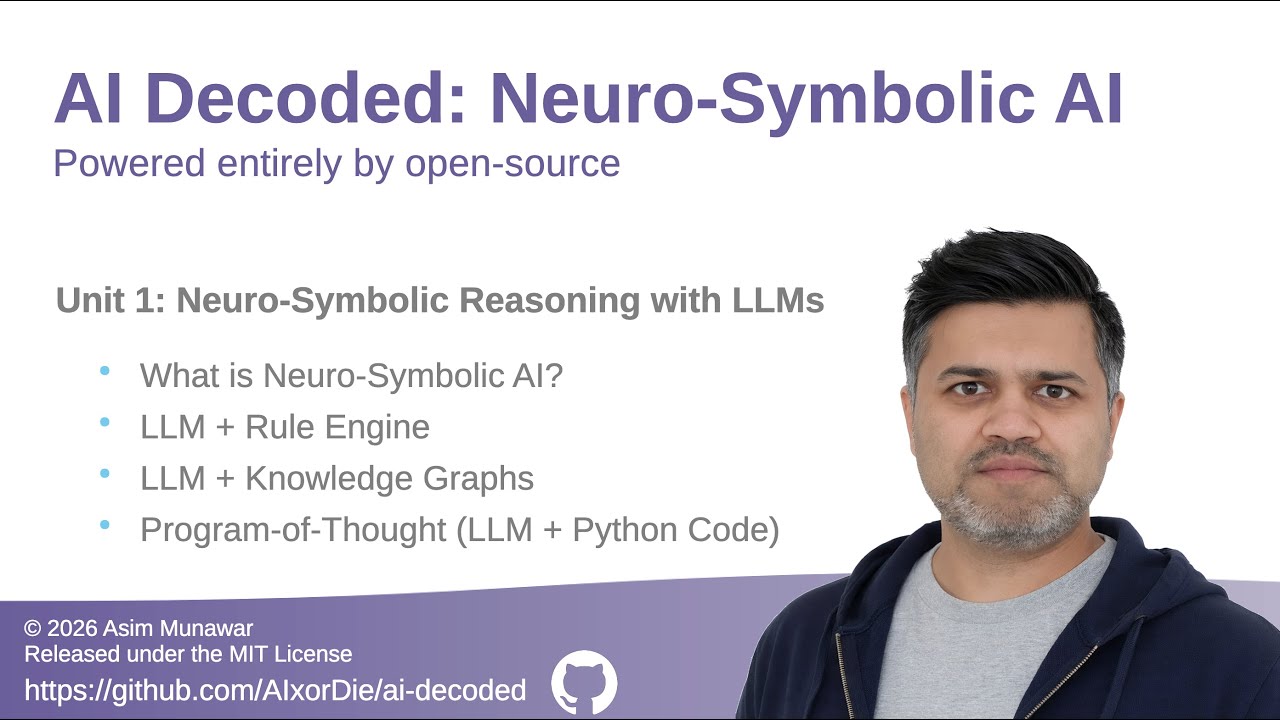

Автор: Asim Munawar

Загружено: 2026-01-23

Просмотров: 286

Описание:

Большие языковые модели терпят неудачу в производственной среде не из-за обучения, а из-за вывода.

В этом видео я пошагово разбираю статью из блога разработчиков NVIDIA под названием «Освоение методов работы с большими языковыми моделями: оптимизация вывода» и объясняю основные технические идеи, лежащие в основе эффективного вывода с помощью больших языковых моделей.

Это технический обзор в стиле телесуфлера:

• Без слайдов

• Без лишней рекламы

• Структурированное, ориентированное на инженерные аспекты объяснение, основанное на оригинальной статье

━━━━━━━━━━━━━━━━━━━━━

Что рассматривается в этом видео

━━━━━━━━━━━━━━━━━━━━━

• Почему вывод LLM, а не обучение, является реальным узким местом в производстве

• Трансформаторы только с декодером и авторегрессивная генерация токенов

• Разница между фазами предварительного заполнения и декодирования

• Почему декодирование ограничено памятью (матрично-векторные операции) и неэффективно использует графические процессоры

• Стратегии пакетной обработки:

– Статическая пакетная обработка

– Динамическая/обрабатываемая пакетная обработка

• Кэш ключ-значение:

– Почему он необходим для вывода результатов

– Почему он занимает доминирующее положение по использованию памяти

• Распределение памяти при выводе результатов LLM:

– Веса модели

– Рост кэша ключ-значение в зависимости от длины последовательности и размера пакета

• Параллелизм моделей для масштабирования за пределы одного графического процессора:

– Параллелизм конвейера

– Параллелизм тензоров

– Параллелизм последовательностей

• Оптимизация механизма внимания:

– Многоголовочный механизм внимания (MHA)

– Многозапросный механизм внимания (MQA)

– Группированный механизм внимания (GQA)

– FlashAttention

• Эффективное управление кэшем ключ-значение с помощью страничной организации памяти

• Почему наивное избыточное выделение памяти в кэше ключ-значение снижает пропускную способность

• Как такие фреймворки, как TensorRT-LLM, реализуют эти оптимизации практика

━━━━━━━━━━━━━━━━━━━━━

Ключевой вывод

━━━━━━━━━━━━━━━━━━━━

• Производительность вывода LLM в основном ограничена пропускной способностью памяти, а не вычислительными ресурсами.

• Понимание этого меняет ваше представление о развертывании, масштабировании и системе. дизайн

━━━━━━━━━━━━━━━━━━━━━

Ссылки

━━━━━━━━━━━━━━━━━━━━

• Блог разработчиков NVIDIA: Освоение методов LLM — Оптимизация вывода: https://developer.nvidia.com/blog/mas...

• Учебные материалы с открытым исходным кодом: https://github.com/AIxorDie/ai-decoded

• Плейлисты AI Decoded: https://www.youtube.com/@asimmunawar/...

Повторяем попытку...

Доступные форматы для скачивания:

Скачать видео

-

Информация по загрузке: