How Much Do Language Models Memorize?

Автор: Google TechTalks

Загружено: 2026-01-26

Просмотров: 68

Описание:

A Google TechTalk, 2025-07-30, presented by Jack Morris

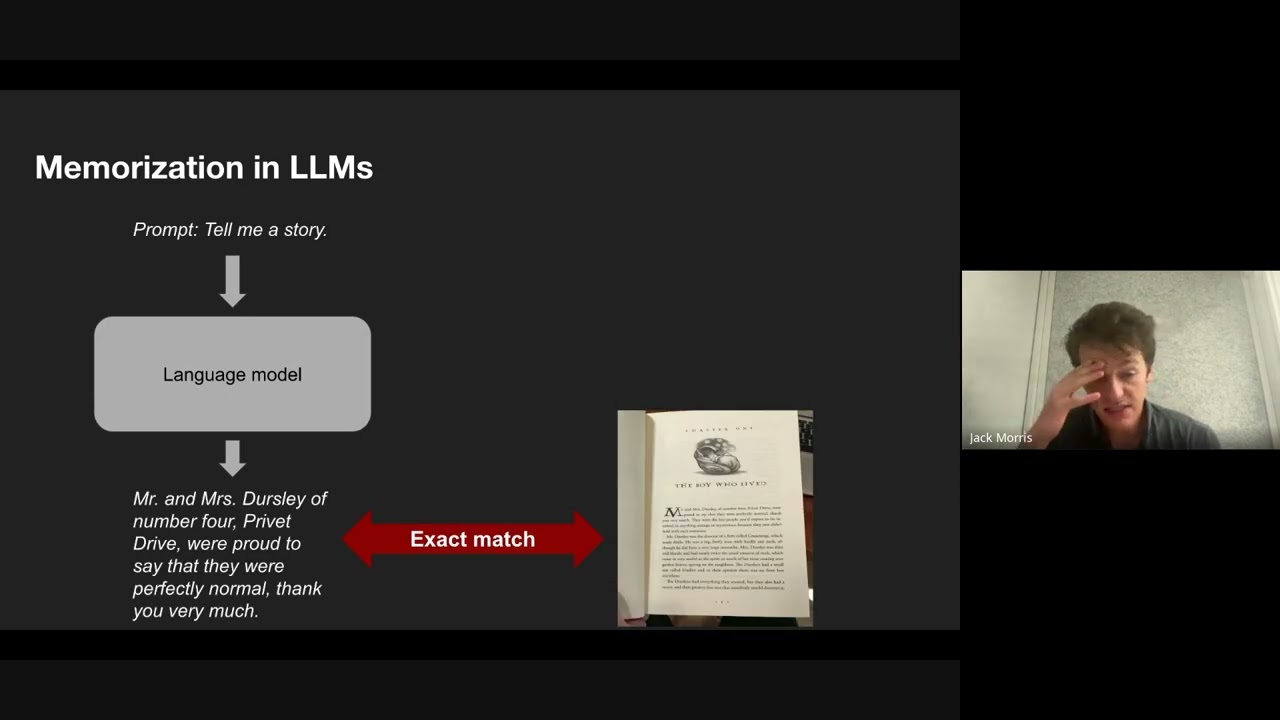

Privacy in Machine Learning Seminar. ABSTRACT: We propose a new method for estimating how much a model ``knows'' about a datapoint and use it to measure the capacity of modern language models. Prior studies of language model memorization have struggled to disentangle memorization from generalization. We formally separate memorization into two components: \textit{unintended memorization}, the information a model contains about a specific dataset, and \textit{generalization}, the information a model contains about the true data-generation process. When we completely eliminate generalization, we can compute the total memorization, which provides an estimate of model capacity: our measurements estimate that GPT-style models have a capacity of approximately 3.6 bits per parameter. We train language models on datasets of increasing size and observe that models memorize until their capacity fills, at which point ``grokking'' begins, and unintended memorization decreases as models begin to generalize. We train hundreds of transformer language models ranging from to parameters and produce a series of scaling laws relating model capacity and data size to membership inference.

Повторяем попытку...

Доступные форматы для скачивания:

Скачать видео

-

Информация по загрузке: